Le challenge

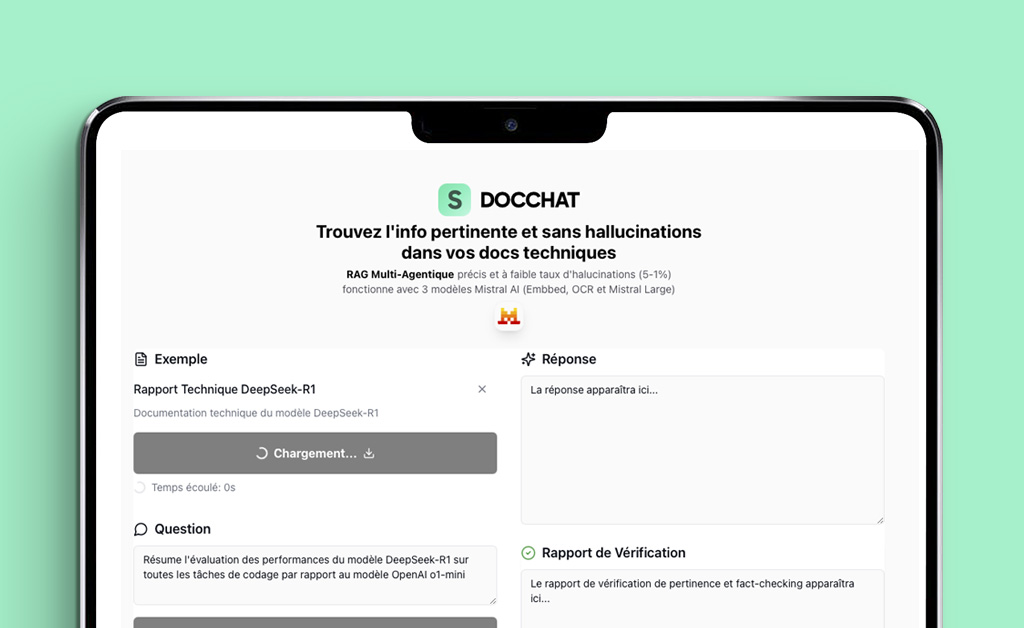

Créer un système RAG qui récupère de l'information factcheckée et pertinente sur des documentations techniques.

- Pertinence de la récupération. Remonter les passages exacts malgré le bruit, le vocabulaire technique et les tableaux.

- Factcheck des réponses. Éviter les hallucinations et ne répondre qu'avec des preuves dans le contexte.

- Couvrir de multiples documents et pages. Croiser plusieurs sources sans perdre l'information clé.

- Vérifier la qualité OCR avec Mistral OCR. Extraire du texte propre depuis des PDF longs et hétérogènes.

- Évaluer la pertinence. Prouver la pertinence avec des métriques et des comparaisons avant/après.

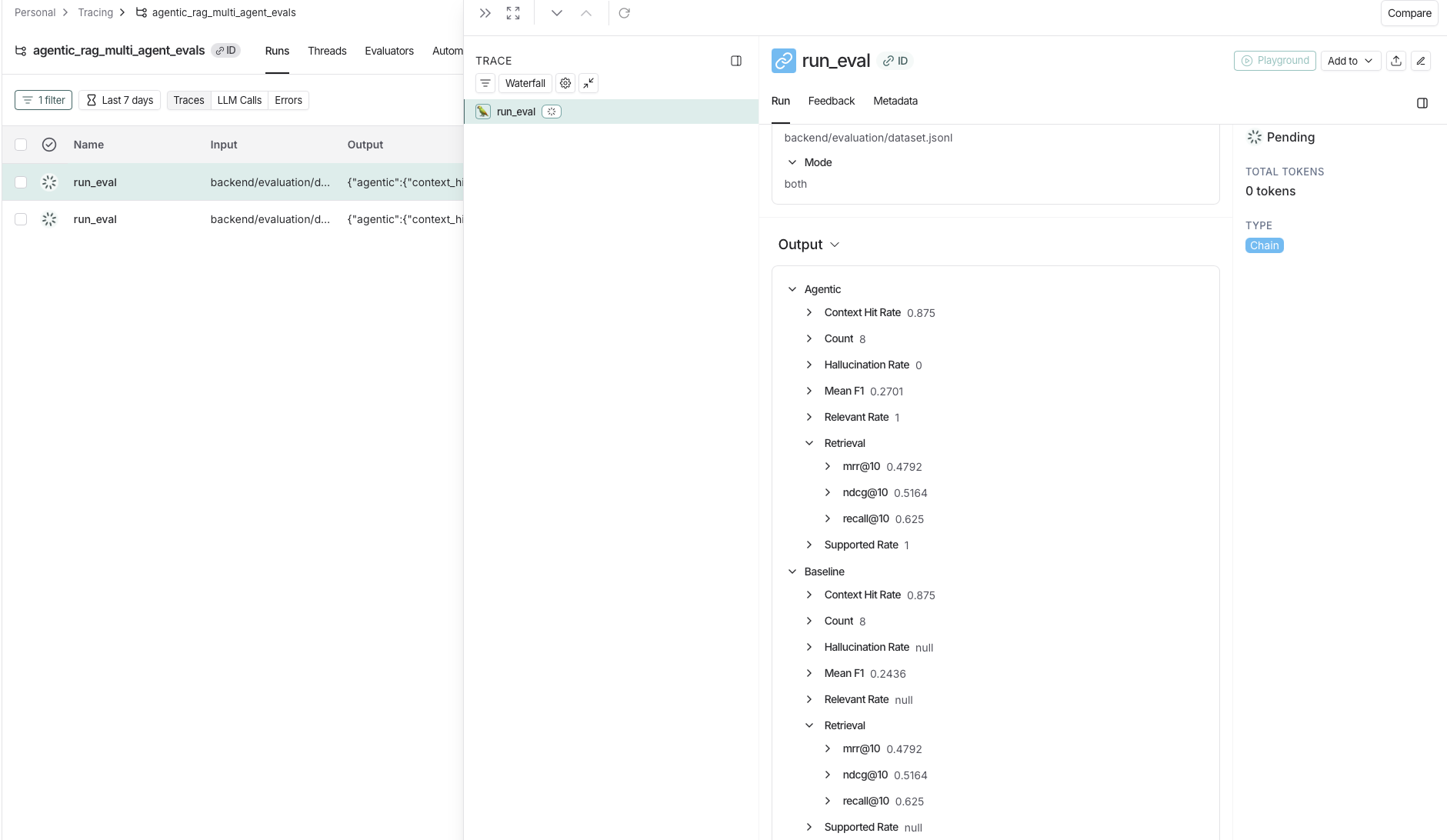

Résultats & évaluation

- Récupération hybride + 2 agents spécialisés (FactChecker & PertinenceChecker). La combinaison BM25 + recherche vectorielle améliore la couverture et la pertinence sur des docs techniques.

- Recall@10 : 37,5 % → 62,5 %. 5 questions sur 8 ont au moins un passage pertinent dans le top 10.

- MRR@10 : 27,6 % → 47,9 %. En moyenne le 1ᵉʳ bon passage arrive vers la 2ᵉ place.

- nDCG@10 : 35,9 % → 51,6 %. Classement global de pertinence correct, mais pas encore excellent.

- 2-5 % d'hallucinations grâce au reranker — à valider sur une plus large quantité de données.

- 81 % des réponses jugées pertinentes par RAGAS, testé sur 2 documents.

Bon POC. À améliorer pour passage à l'échelle.

Tu as un projet RAG ? On en parle sur LinkedIn.

13K+ abonnés

in / julien-lucas-jl

3 à 4 posts par semaine. Tout ce que j'apprends, pendant que je l'apprends.

Recaps de papiers récents en français, techniques RAG / agents / fine-tuning que je teste sur mes produits, et coulisses de Whatsapp IA et LeadFlow en prod. Si l'IA appliquée t'intéresse, c'est l'endroit.

Voir mon LinkedInTu préfères m'écrire ? julienlucas84@gmail.com